L’essor des chatbots IA comme ChatGPT s’est inévitablement étendu aux soins de santé. Les gens utilisent déjà ces outils pour des questions médicales, cherchant souvent des réponses rapides aux symptômes ou aux résultats de laboratoire lorsqu’une aide professionnelle n’est pas immédiatement disponible. Aujourd’hui, OpenAI a lancé « ChatGPT Health », une fonctionnalité dédiée conçue pour suivre cette tendance – mais elle ne remplace pas les médecins et comporte des risques importants.

Plus de 5 % de toutes les interactions ChatGPT dans le monde impliquent désormais des requêtes liées à la santé, avec plus de 40 millions d’utilisateurs hebdomadaires recherchant des informations médicales. Cette demande a incité OpenAI à créer une expérience plus ciblée au sein de sa plateforme, mais l’outil n’est explicitement pas conçu pour diagnostiquer ou traiter des maladies.

Qu’est-ce que ChatGPT Santé ?

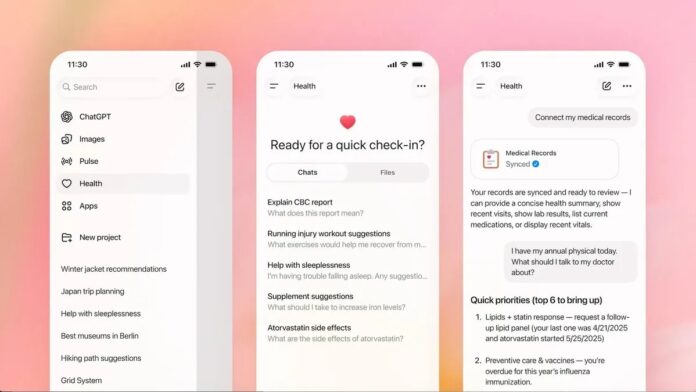

ChatGPT Health n’est pas une application autonome. Au lieu de cela, il s’agit d’un onglet spécialisé au sein de l’interface ChatGPT existante, offrant un espace pour les questions liées à la santé, l’analyse de documents et la prise en charge du flux de travail. OpenAI affirme que le système a été développé avec la contribution de plus de 260 médecins dans 60 pays sur deux ans, soumis à des tests rigoureux avec plus de 600 000 examens de réponses modèles. Le résultat est une IA plus prudente et contrainte, conçue pour encourager la consultation médicale professionnelle.

Actuellement, l’accès est limité aux États-Unis, au Canada, en Australie, dans certaines parties de l’Asie et de l’Amérique latine. L’UE, le Royaume-Uni, la Chine et la Russie sont exclus en raison de différentes réglementations concernant les données de santé. OpenAI prévoit d’étendre la disponibilité, même si les délais restent incertains.

Comment ça marche : des données, pas de la magie

ChatGPT Health ne représente pas une percée dans la compréhension de la médecine par l’IA. Selon Alex Kotlar de Bystro AI, la technologie de base reste la même : “Ils n’ont pas créé un modèle qui comprendrait beaucoup mieux les dossiers médicaux. Il s’agit toujours de ChatGPT, simplement connecté à vos dossiers médicaux.”

La clé est le contexte. L’outil peut s’intégrer aux données d’Apple Health, aux résultats de laboratoire (de services comme Function) et même aux journaux alimentaires de MyFitnessPal et Weight Watchers. Cela permet d’obtenir des informations personnalisées basées sur votre historique, mais nécessite une autorisation explicite pour accéder à vos données.

OpenAI utilise un cadre d’évaluation appelé HealthBench, appliquant plus de 48 000 critères pour évaluer la qualité et la sécurité des réponses. Ce cadre s’appuie sur des rubriques rédigées par des médecins pour évaluer les performances du modèle dans des scénarios de santé simulés.

Confidentialité et limites : un produit de consommation non conforme à la loi HIPAA

ChatGPT Health fonctionne comme un produit de consommation, ce qui signifie qu’il n’est pas soumis aux mêmes réglementations strictes que les systèmes de santé cliniques. OpenAI déclare explicitement que la HIPAA (la Health Insurance Portability and Accountability Act) ne s’applique pas. Pour une utilisation clinique réglementée, OpenAI propose un service distinct « ChatGPT for Healthcare » conforme à la HIPAA.

OpenAI met l’accent sur des mesures de sécurité supplémentaires telles que le cryptage, mais les experts mettent en garde contre un excès de confiance. “Le chiffrement au repos ne signifie pas que l’entreprise elle-même ne peut pas accéder aux données”, prévient Kotlar. Les utilisateurs peuvent déconnecter des applications, supprimer des enregistrements et supprimer des souvenirs spécifiques à la santé, mais les risques restent inhérents au stockage d’informations sensibles en ligne.

Le vrai danger : hallucinations et désinformation

La préoccupation la plus importante de ChatGPT Health n’est pas la confidentialité, mais l’exactitude. Les modèles d’IA, y compris celui-ci, sont sujets aux « hallucinations » – fournissant en toute confiance des informations incorrectes. Dans le domaine de la santé, cela peut avoir de graves conséquences.

L’ECRI, une organisation à but non lucratif dédiée à la sécurité des patients, a déjà identifié les chatbots IA comme la principale norme en matière de technologie de santé pour 2026, soulignant le potentiel de préjudice. Même OpenAI admet que les anciens modèles présentaient des taux d’hallucinations plus élevés, bien qu’ils affirment que GPT-5 a considérablement réduit ces erreurs.

“Le plus grand danger pour les consommateurs est que, s’ils n’ont pas de formation médicale, ils auront du mal à évaluer quand quelque chose est vrai et quand il dit quelque chose de mal”, explique Kotlar.

L’essentiel

ChatGPT Health est un outil pour compléter, et non remplacer, les soins médicaux professionnels. Il peut aider à traduire des informations complexes, à organiser des questions pour des rendez-vous ou à fournir des informations générales sur le bien-être. Cependant, il est crucial de vérifier toute information auprès de sources fiables et d’éviter tout autodiagnostic. La valeur de cet outil réside dans sa capacité à améliorer l’accès à l’information, mais ses limites et ses risques doivent être compris. L’essor de l’IA dans le domaine de la santé est inévitable, mais son utilisation responsable nécessite prudence et une conscience claire de ses limites.