Der Aufstieg von KI-Chatbots wie ChatGPT hat sich unweigerlich auch auf das Gesundheitswesen ausgeweitet. Menschen nutzen diese Tools bereits für medizinische Fragen und suchen oft nach schnellen Antworten auf Symptome oder Laborergebnisse, wenn professionelle Hilfe nicht sofort verfügbar ist. Jetzt hat OpenAI „ChatGPT Health“ eingeführt, eine spezielle Funktion, die diesem Trend entgegenwirken soll – sie ist jedoch kein Ersatz für Ärzte und birgt erhebliche Risiken.

Über 5 % aller ChatGPT-Interaktionen weltweit beinhalten mittlerweile gesundheitsbezogene Anfragen, wobei über 40 Millionen wöchentliche Benutzer nach medizinischen Informationen suchen. Diese Nachfrage veranlasste OpenAI, ein fokussierteres Erlebnis innerhalb seiner Plattform zu schaffen, aber das Tool ist ausdrücklich nicht für die Diagnose oder Behandlung von Erkrankungen konzipiert.

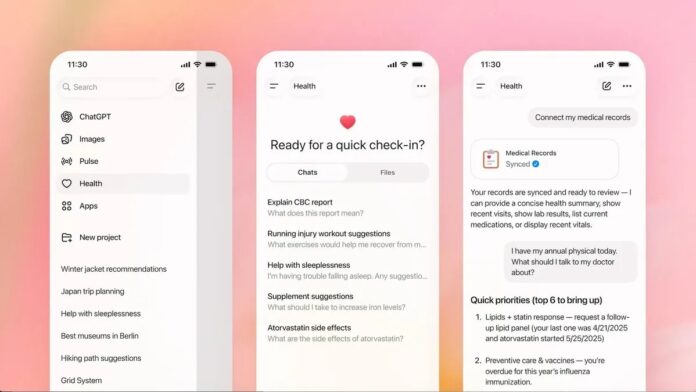

Was ist ChatGPT Health?

ChatGPT Health ist keine eigenständige App. Stattdessen handelt es sich um eine spezielle Registerkarte innerhalb der bestehenden ChatGPT-Oberfläche, die Platz für gesundheitsbezogene Fragen, Dokumentenanalyse und Workflow-Unterstützung bietet. OpenAI gibt an, dass das System mit Hilfe von über 260 Ärzten aus 60 Ländern über einen Zeitraum von zwei Jahren entwickelt wurde und strengen Tests mit mehr als 600.000 Überprüfungen von Modellantworten unterzogen wurde. Das Ergebnis ist eine vorsichtigere und eingeschränktere KI, die eine professionelle medizinische Beratung fördern soll.

Derzeit ist der Zugang auf die USA, Kanada, Australien, Teile Asiens und Lateinamerika beschränkt. Die EU, das Vereinigte Königreich, China und Russland sind aufgrund unterschiedlicher Vorschriften für Gesundheitsdaten ausgeschlossen. OpenAI plant, die Verfügbarkeit zu erweitern, der Zeitplan bleibt jedoch ungewiss.

Wie es funktioniert: Daten, keine Magie

ChatGPT Health stellt keinen Durchbruch im KI-Verständnis der Medizin dar. Laut Alex Kotlar von Bystro AI bleibt die Kerntechnologie dieselbe: „Sie haben kein Modell entwickelt, das Krankenakten plötzlich viel besser versteht. Es ist immer noch ChatGPT, nur mit Ihren Krankenakten verbunden.“

Der Schlüssel ist Kontext. Das Tool kann Daten von Apple Health, Laborergebnisse (von Diensten wie Function) und sogar Lebensmittelprotokolle von MyFitnessPal und Weight Watchers integrieren. Dies ermöglicht personalisierte Einblicke auf der Grundlage Ihres Verlaufs, erfordert jedoch eine ausdrückliche Genehmigung für den Zugriff auf Ihre Daten.

OpenAI verwendet einen Bewertungsrahmen namens HealthBench, der über 48.000 Kriterien anwendet, um die Qualität und Sicherheit von Antworten zu bewerten. Dieses Framework basiert auf von Ärzten verfassten Rubriken zur Bewertung der Modellleistung in simulierten Gesundheitsszenarien.

Datenschutz und Einschränkungen: Ein Verbraucherprodukt, nicht HIPAA-konform

ChatGPT Health ist ein Verbraucherprodukt und unterliegt daher nicht den gleichen strengen Vorschriften wie klinische Gesundheitssysteme. OpenAI weist ausdrücklich darauf hin, dass HIPAA (der Health Insurance Portability and Accountability Act) keine Anwendung findet. Für den regulierten klinischen Einsatz bietet OpenAI einen separaten „ChatGPT for Healthcare“-Dienst mit HIPAA-Konformität an.

OpenAI legt Wert auf zusätzliche Sicherheitsmaßnahmen wie Verschlüsselung, Experten warnen jedoch vor Selbstüberschätzung. „Eine Verschlüsselung im Ruhezustand bedeutet nicht, dass das Unternehmen selbst nicht auf die Daten zugreifen kann“, warnt Kotlar. Benutzer können Apps trennen, Datensätze entfernen und gesundheitsspezifische Erinnerungen löschen, die Online-Speicherung sensibler Informationen bleibt jedoch mit Risiken verbunden.

Die wahre Gefahr: Halluzinationen und Fehlinformationen

Das wichtigste Anliegen bei ChatGPT Health ist nicht der Datenschutz, sondern die Genauigkeit. KI-Modelle, darunter auch dieses, neigen zu „Halluzinationen“ – sie liefern selbstbewusst falsche Informationen. Im Gesundheitswesen kann dies schwerwiegende Folgen haben.

ECRI, eine gemeinnützige Organisation für Patientensicherheit, hat KI-Chatbots bereits als den wichtigsten Gesundheitstechnologiestandard für 2026 identifiziert und dabei das Schadenspotenzial hervorgehoben. Sogar OpenAI gibt zu, dass ältere Modelle höhere Halluzinationsraten aufwiesen, behauptet jedoch, dass GPT-5 diese Fehler erheblich reduziert habe.

„Die größte Gefahr für Verbraucher besteht darin, dass es ihnen, sofern sie keinen medizinischen Hintergrund haben, schwer fällt, zu beurteilen, wann etwas richtig und wann etwas falsch ist“, erklärt Kotlar.

Das Fazit

ChatGPT Health ist ein Tool zur Ergänzung, nicht zum Ersatz der professionellen medizinischen Versorgung. Es kann helfen, komplexe Informationen zu übersetzen, Fragen für Termine zu organisieren oder allgemeine Einblicke in das Wohlbefinden zu geben. Es ist jedoch wichtig, alle Informationen anhand seriöser Quellen zu überprüfen und eine Selbstdiagnose zu vermeiden. Der Wert des Tools liegt in seinem Potenzial, den Zugang zu Informationen zu verbessern, seine Grenzen und Risiken müssen jedoch verstanden werden. Der Aufstieg der KI im Gesundheitswesen ist unvermeidlich, aber ein verantwortungsvoller Einsatz erfordert Vorsicht und ein klares Bewusstsein für ihre Grenzen.